C’est peut-être le principal sentiment qui émerge à la lecture des « Facebook Files ». Parmi ces milliers de pages de documents internes à Facebook, récupérés par Frances Haugen, une ancienne employée, et transmis par une source parlementaire américaine à plusieurs médias, dont Le Monde, de nombreux passages semblent indiquer que Facebook ne comprend plus, ou mal, ce que font ses propres algorithmes. Et que son réseau social est devenu une machine difficile à contrôler.

Les « Facebook Files » sont plusieurs centaines de documents internes à Facebook copiés par Frances Haugen, une spécialiste des algorithmes, lorsqu’elle était salariée du réseau social. Ils ont été fournis au régulateur américain et au Congrès, puis transmis par une source parlementaire américaine à plusieurs médias, expurgés des informations personnelles des salariés de Facebook. En Europe, ces médias sont, outre Le Monde, le quotidien allemand Süddeutsche Zeitung, les chaînes de télévision WDR et NDR, le Groupe Tamedia, Knack, Berlingske et l’OCCRP.

Ils montrent que Facebook consacre davantage de ressources à limiter ses effets néfastes en Occident, au détriment du reste du monde. Ils attestent que ces effets sont connus en interne mais les signaux d’alerte pas toujours pris en compte. Enfin, ils prouvent que les algorithmes de Facebook sont devenus d’une complexité telle qu’ils semblent parfois échapper à leurs propres auteurs. Retrouvez tous nos articles en cliquant ici.

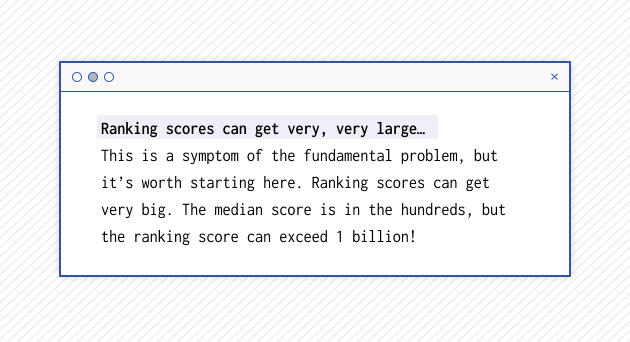

C’est notamment le cas pour un algorithme crucial, chargé de « classer » les messages qui s’affichent dans le fil d’actualité des utilisateurs : Facebook utilise une multitude de signaux, des plus simples – le nombre de personnes abonnées à une page – aux plus complexes – l’intérêt que les « amis » d’un utilisateur ont manifesté pour un sujet – afin d’attribuer un « score » à un message. Plus ce score est élevé, plus il a des chances d’apparaître dans le fil d’actualités.

Or, avec le temps et l’accumulation de nouveaux signaux ajoutés par les ingénieurs du réseau social, le « score » moyen d’un message a explosé. Dans un document non daté, un analyste de Facebook a procédé à quelques calculs, et constate que pour certains contenus, le score « peut dépasser 1 milliard ». Ce qui a pour conséquence très directe de rendre de nombreux outils de modération inopérants. Ces derniers réduisent de 20 %, 30 % ou 50 % le score de certains messages problématiques, afin d’éviter qu’ils ne soient trop diffusés. Mais pour les contenus les mieux notés, le score est tellement élevé que le diviser par deux ne les empêche pas de continuer à s’afficher. « Certains de ces contenus resteraient en tête même si on appliquait une baisse de leur score de 90 % », regrette l’auteur du document.

Système complexe sans « vision unifiée »

Ce problème n’est absolument pas le résultat d’une politique intentionnellement mise en place, qui considérerait que certains messages devraient être immunisés contre les outils de modération automatiques. C’est simplement l’un des très nombreux effets de bord provoqués par les centaines de modifications des algorithmes de Facebook, au fil des ans, dont les propres ingénieurs du réseau social semblent ne pas pouvoir anticiper toutes les conséquences.

« Les différentes parties des applications de Facebook interagissent les unes avec les autres de façon complexe » et chaque équipe développe des modifications sans qu’il y ait une « vision systémique unifiée », regrette ainsi l’employée Mary Beth Hunzaker, dans une longue note rédigée à l’occasion de son départ de Facebook, en août 2020. La conséquence ? « Un risque accru de problèmes facilités ou amplifiés par des interactions imprévues entre des fonctions ou des services de la plate-forme. »

Il vous reste 79.72% de cet article à lire. La suite est réservée aux abonnés.